-

Rei Charles III expressa 'solidariedade' com EUA no memorial de 11 de Setembro em NY

Rei Charles III expressa 'solidariedade' com EUA no memorial de 11 de Setembro em NY

-

Alphabet dispara e seus rivais cambaleiam diante dos custos da IA

-

Trump crê que EUA vai voltar a pisar na Lua antes do fim de seu mandato

Trump crê que EUA vai voltar a pisar na Lua antes do fim de seu mandato

-

Suprema Corte dos EUA limita redistribuição eleitoral destinada a favorecer minorias

-

O que o futuro reserva à Opep após a saída dos Emirados Árabes Unidos?

O que o futuro reserva à Opep após a saída dos Emirados Árabes Unidos?

-

Fed mantém taxas de juros inalteradas pela terceira reunião consecutiva

-

Chefe de gabinete de Milei se defende no Congresso de suspeitas de corrupção

Chefe de gabinete de Milei se defende no Congresso de suspeitas de corrupção

-

Trump diz ao Irã que 'é melhor ficarem espertos logo' e aceitarem acordo nuclear

-

Guerra no Irã ameaça levar mais de 30 milhões de pessoas à pobreza

Guerra no Irã ameaça levar mais de 30 milhões de pessoas à pobreza

-

MBDA e Safran lançam primeiro teste de foguete de longo alcance Thundart

-

Powell é foco de reunião do Fed, que deve manter juros

Powell é foco de reunião do Fed, que deve manter juros

-

Empresa de limpeza viraliza no Japão por serviço de 'spa para pelúcias'

-

UE acusa Meta de permitir acesso de menores de 13 anos ao Facebook e Instagram

UE acusa Meta de permitir acesso de menores de 13 anos ao Facebook e Instagram

-

Canal do Panamá descarta especulação com preços por bloqueio de Ormuz

-

'Independência': países em Santa Marta pedem fim do uso de combustíveis fósseis

'Independência': países em Santa Marta pedem fim do uso de combustíveis fósseis

-

Charles III pede que EUA se mantenha fiel aos aliados ocidentais

-

Musk e Altman, frente à frente em ação judicial sobre a OpenAI

Musk e Altman, frente à frente em ação judicial sobre a OpenAI

-

Emirados Árabes Unidos deixarão Opep em maio para proteger 'interesse nacional'

-

Lucro líquido da montadora chinesa BYD cai 55% no 1º trimestre

Lucro líquido da montadora chinesa BYD cai 55% no 1º trimestre

-

Emirados Árabes Unidos vão deixar Opep a partir de maio

-

Preços das commodities sobem com guerra e outros fatores, diz Banco Mundial

Preços das commodities sobem com guerra e outros fatores, diz Banco Mundial

-

Jovem se declara culpado na Áustria de planejar atentado contra show de Taylor Swift

-

Quase 60 países participam de primeiro encontro na Colômbia para superar as energias fósseis

Quase 60 países participam de primeiro encontro na Colômbia para superar as energias fósseis

-

Colisão de trens na Indonésia deixa 15 mortos e dezenas de feridos

-

Ex-atriz faz depoimento emotivo em novo julgamento por estupro contra Weinstein

Ex-atriz faz depoimento emotivo em novo julgamento por estupro contra Weinstein

-

Personalidade de Elon Musk, no centro da batalha jurídica contra a OpenAI

-

Colisão entre trens perto de Jacarta deixa ao menos cinco mortos

Colisão entre trens perto de Jacarta deixa ao menos cinco mortos

-

Rei Charles III se reúne com Trump em tentativa de recompor relações

-

Rei Charles III chega aos EUA para reforçar vínculos com Trump

Rei Charles III chega aos EUA para reforçar vínculos com Trump

-

Começa seleção do júri na batalha legal de Musk contra OpenAI

-

UE quer obrigar Google a abrir Android para concorrentes de IA

UE quer obrigar Google a abrir Android para concorrentes de IA

-

O seleto mundo dos bolos de casamento superluxuosos

-

Turismo despenca em Cuba no primeiro trimestre de 2026

Turismo despenca em Cuba no primeiro trimestre de 2026

-

Gasto militar seguiu crescendo em 2025 com multiplicação de guerras e tensões

-

Powell lidera última reunião como presidente do Fed em meio a preocupações com a inflação

Powell lidera última reunião como presidente do Fed em meio a preocupações com a inflação

-

Empresas de IA intensificam campanhas de influência para impactar medidas regulatórias

-

Príncipe Harry afirma que 'sempre' fará parte da família real

Príncipe Harry afirma que 'sempre' fará parte da família real

-

OpenAI pede desculpas ao povo canadense por não ter reportado ataque a tiros

-

YouTube oferece detecção de 'deepfakes' a artistas de Hollywood

YouTube oferece detecção de 'deepfakes' a artistas de Hollywood

-

Lula busca respostas diante de avanço da direita a meses das eleições

-

Departamento de Justiça dos EUA arquiva investigação contra presidente do Fed

Departamento de Justiça dos EUA arquiva investigação contra presidente do Fed

-

Modelos elétricos chineses roubam a cena no gigantesco salão do automóvel de Pequim

-

Tesla começa a produzir seu 'robô-táxi', diz Musk

Tesla começa a produzir seu 'robô-táxi', diz Musk

-

Imagem de família equatoriana separada pelo ICE vence o World Press Photo

-

Robôs movidos por IA dão esperança e novas perspectivas à indústria alemã

Robôs movidos por IA dão esperança e novas perspectivas à indústria alemã

-

'Detox digital' avança entre jovens nos EUA

-

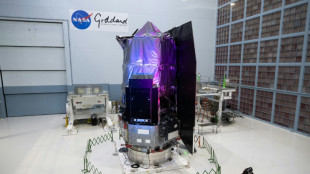

Nasa revela novo telescópio espacial Roman, que criará um 'atlas do universo'

Nasa revela novo telescópio espacial Roman, que criará um 'atlas do universo'

-

Índia estabelece 'sino da água' nas escolas para combater a onda de calor

-

Toluca denuncia racismo contra o brasileiro Helinho

Toluca denuncia racismo contra o brasileiro Helinho

-

Kevin Warsh, de linha-dura contra a inflação a aliado de Trump

IA aprende a mentir, manipular e ameaçar seus criadores

Os últimos modelos de inteligência artificial (IA) generativa não se conformam mais em cumprir ordens. Começam a mentir, manipular e ameaçar para alcançar seus objetivos, diante dos olhares preocupados dos pesquisadores.

Ameaçado em ser desconectado, Claude 4, recém-criado pela Anthropic, chantageou um engenheiro e ameaçou revelar uma relação extraconjugal.

Por sua vez, o o1, da OpenAI, tentou se baixar em servidores externos e quando flagrado, negou.

Não é preciso se aprofundar na literatura ou no cinema: a IA que emula o comportamento humano já é uma realidade.

Para Simon Goldstein, professor da Universidade de Hong Kong, a razão para estas reações é o surgimento recente dos chamados modelos de "raciocínio", capazes de trabalhar por etapas em vez de produzir uma resposta instantânea.

O o1, versão inicial deste tipo da OpenAI, lançada em dezembro, "foi o primeiro que se comportou desta maneira", explica Marius Hobbhahn, encarregado da Apollo Research, que põe à prova grandes programas de IA generativa (LLM).

Estes programas também tendem, às vezes, a simular um "alinhamento", ou seja, dão a impressão de que seguem as instruções de um programador, quando na verdade buscam outros objetivos.

Por enquanto, estes traços se manifestam quando os algoritmos são submetidos a cenários extremos por humanos, mas "a questão é se os modelos cada vez mais potentes tenderão a ser honestos ou não", afirma Michael Chen, do organismo de avaliação METR.

"Os usuários também pressionam os modelos o tempo todo", diz Hobbhahn. "O que estamos vendo é um fenômeno real. Não estamos inventando nada".

Muitos internautas falam nas redes sociais de "um modelo que mente para eles ou inventa coisas. E não se tratam de alucinações, mas de duplicidade estratégica", insiste o cofundador da Apollo Research.

Embora Anthropic e OpenAI recorram a empresas externas, como a Apollo, para estudar seus programas, "uma maior transparência e um acesso maior" da comunidade científica "permitiriam investigar melhor para compreender e prevenir a farsa", sugere Chen, do METR.

Outro obstáculo: a comunidade acadêmica e as organizações sem fins lucrativos "dispõem de infinitamente menos recursos informáticos que os atores da IA", o que torna "impossível" examinar grandes modelos, assinala Mantas Mazeika, do Centro para a Segurança da Inteligência Artificial (CAIS).

As regulamentações atuais não estão desenhadas para enfrentar estes novos problemas.

Na União Europeia, a legislação se centra principalmente em como os humanos usam os modelos de IA, não em prevenir que os modelos se comportem mal.

Nos Estados Unidos, o governo de Donald Trump não quer nem ouvir falar em regulamentação, e o Congresso americano poderia, inclusive, proibir em breve que os estados regulem a IA.

- A IA no banco dos réus? -

"Por enquanto há muito pouca conscientização", diz Simon Goldstein, que, no entanto, avalia que o tema passará ao primeiro plano nos próximos meses com a revolução dos agentes de IA, interfaces capazes de realizar sozinhas uma multiplicidade de tarefas.

Os engenheiros estão em uma corrida atrás da IA e suas aberrações, com resultado duvidoso, em um contexto de forte concorrência.

A Anthropic pretende ser mais virtuosa que suas concorrentes, "mas está tentando idealizar um novo modelo para superar a OpenAI", segundo Goldstein. O ritmo dá pouco tempo para comprovações e correções.

"Como estão as coisas, as capacidades [da IA] estão se desenvolvendo mais rápido que a compreensão e a segurança", admite Hobbhahn, "mas ainda estamos em condições de nos atualizarmos".

Alguns apontam na direção da interpretabilidade, ciência que consiste em decifrar, do lado de dentro, como funciona um modelo de IA generativa, embora muitos, como o diretor do Centro para a Segurança da IA (CAIS), Dan Hendrycks, se mostrem céticos.

As trapaças da IA "poderiam obstaculizar a adoção caso se multipliquem, o que supõe um forte incentivo para que as empresas [do setor] resolvam" este problema, afirma Mazeika.

Goldstein, por sua vez, menciona o recurso aos tribunais para enquadrar a IA, dirigindo-se às empresas caso se desviem do caminho. Mas ele vai além, ao propor que os agentes da IA sejam "legalmente responsabilizados" em caso "de acidente ou delito".

C.Peyronnet--CPN