-

Irã desafia bloqueio dos EUA e preço do petróleo dispara

Irã desafia bloqueio dos EUA e preço do petróleo dispara

-

Países unem forças em Santa Marta para começar a se afastar do petróleo

-

Rei Charles III expressa 'solidariedade' com EUA no memorial de 11 de Setembro em NY

Rei Charles III expressa 'solidariedade' com EUA no memorial de 11 de Setembro em NY

-

Alphabet dispara e seus rivais cambaleiam diante dos custos da IA

-

Trump crê que EUA vai voltar a pisar na Lua antes do fim de seu mandato

Trump crê que EUA vai voltar a pisar na Lua antes do fim de seu mandato

-

Suprema Corte dos EUA limita redistribuição eleitoral destinada a favorecer minorias

-

O que o futuro reserva à Opep após a saída dos Emirados Árabes Unidos?

O que o futuro reserva à Opep após a saída dos Emirados Árabes Unidos?

-

Fed mantém taxas de juros inalteradas pela terceira reunião consecutiva

-

Chefe de gabinete de Milei se defende no Congresso de suspeitas de corrupção

Chefe de gabinete de Milei se defende no Congresso de suspeitas de corrupção

-

Trump diz ao Irã que 'é melhor ficarem espertos logo' e aceitarem acordo nuclear

-

Guerra no Irã ameaça levar mais de 30 milhões de pessoas à pobreza

Guerra no Irã ameaça levar mais de 30 milhões de pessoas à pobreza

-

MBDA e Safran lançam primeiro teste de foguete de longo alcance Thundart

-

Powell é foco de reunião do Fed, que deve manter juros

Powell é foco de reunião do Fed, que deve manter juros

-

Empresa de limpeza viraliza no Japão por serviço de 'spa para pelúcias'

-

UE acusa Meta de permitir acesso de menores de 13 anos ao Facebook e Instagram

UE acusa Meta de permitir acesso de menores de 13 anos ao Facebook e Instagram

-

Canal do Panamá descarta especulação com preços por bloqueio de Ormuz

-

'Independência': países em Santa Marta pedem fim do uso de combustíveis fósseis

'Independência': países em Santa Marta pedem fim do uso de combustíveis fósseis

-

Charles III pede que EUA se mantenha fiel aos aliados ocidentais

-

Musk e Altman, frente à frente em ação judicial sobre a OpenAI

Musk e Altman, frente à frente em ação judicial sobre a OpenAI

-

Emirados Árabes Unidos deixarão Opep em maio para proteger 'interesse nacional'

-

Lucro líquido da montadora chinesa BYD cai 55% no 1º trimestre

Lucro líquido da montadora chinesa BYD cai 55% no 1º trimestre

-

Emirados Árabes Unidos vão deixar Opep a partir de maio

-

Preços das commodities sobem com guerra e outros fatores, diz Banco Mundial

Preços das commodities sobem com guerra e outros fatores, diz Banco Mundial

-

Jovem se declara culpado na Áustria de planejar atentado contra show de Taylor Swift

-

Quase 60 países participam de primeiro encontro na Colômbia para superar as energias fósseis

Quase 60 países participam de primeiro encontro na Colômbia para superar as energias fósseis

-

Colisão de trens na Indonésia deixa 15 mortos e dezenas de feridos

-

Ex-atriz faz depoimento emotivo em novo julgamento por estupro contra Weinstein

Ex-atriz faz depoimento emotivo em novo julgamento por estupro contra Weinstein

-

Personalidade de Elon Musk, no centro da batalha jurídica contra a OpenAI

-

Colisão entre trens perto de Jacarta deixa ao menos cinco mortos

Colisão entre trens perto de Jacarta deixa ao menos cinco mortos

-

Rei Charles III se reúne com Trump em tentativa de recompor relações

-

Rei Charles III chega aos EUA para reforçar vínculos com Trump

Rei Charles III chega aos EUA para reforçar vínculos com Trump

-

Começa seleção do júri na batalha legal de Musk contra OpenAI

-

UE quer obrigar Google a abrir Android para concorrentes de IA

UE quer obrigar Google a abrir Android para concorrentes de IA

-

O seleto mundo dos bolos de casamento superluxuosos

-

Turismo despenca em Cuba no primeiro trimestre de 2026

Turismo despenca em Cuba no primeiro trimestre de 2026

-

Gasto militar seguiu crescendo em 2025 com multiplicação de guerras e tensões

-

Powell lidera última reunião como presidente do Fed em meio a preocupações com a inflação

Powell lidera última reunião como presidente do Fed em meio a preocupações com a inflação

-

Empresas de IA intensificam campanhas de influência para impactar medidas regulatórias

-

Príncipe Harry afirma que 'sempre' fará parte da família real

Príncipe Harry afirma que 'sempre' fará parte da família real

-

OpenAI pede desculpas ao povo canadense por não ter reportado ataque a tiros

-

YouTube oferece detecção de 'deepfakes' a artistas de Hollywood

YouTube oferece detecção de 'deepfakes' a artistas de Hollywood

-

Lula busca respostas diante de avanço da direita a meses das eleições

-

Departamento de Justiça dos EUA arquiva investigação contra presidente do Fed

Departamento de Justiça dos EUA arquiva investigação contra presidente do Fed

-

Modelos elétricos chineses roubam a cena no gigantesco salão do automóvel de Pequim

-

Tesla começa a produzir seu 'robô-táxi', diz Musk

Tesla começa a produzir seu 'robô-táxi', diz Musk

-

Imagem de família equatoriana separada pelo ICE vence o World Press Photo

-

Robôs movidos por IA dão esperança e novas perspectivas à indústria alemã

Robôs movidos por IA dão esperança e novas perspectivas à indústria alemã

-

'Detox digital' avança entre jovens nos EUA

-

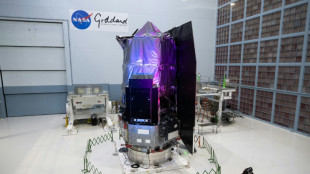

Nasa revela novo telescópio espacial Roman, que criará um 'atlas do universo'

Nasa revela novo telescópio espacial Roman, que criará um 'atlas do universo'

-

Índia estabelece 'sino da água' nas escolas para combater a onda de calor

Inteligência artificial já engana humanos e isso é um problema, dizem especialistas

Especialistas têm alertado há muito tempo sobre a ameaça representada pelo descontrole da inteligência artificial (IA), mas um novo artigo científico sobre essa tecnologia em expansão sugere que isso já está acontecendo.

Os sistemas de IA atuais, projetados para serem honestos, desenvolveram uma habilidade preocupante para a enganação, de acordo com um artigo de uma equipe de pesquisadores publicado na revista Patterns nesta sexta-feira (10).

E embora os exemplos possam parecer triviais, os problemas subjacentes que eles expõem poderiam ter consequências graves, disse o principal autor do estudo, Peter Park, bolsista de pós-doutorado no Instituto de Tecnologia de Massachusetts (MIT), especializado em segurança de IA.

"Esses perigos tendem a ser descobertos apenas depois que ocorrem", afirmou Park à AFP, acrescentando que "nossa capacidade de treinar para tendências de honestidade em vez de tendências de engano é muito baixa".

Ao contrário do software tradicional, os sistemas de IA de aprendizado profundo não são "escritos", mas "crescem" por meio de um processo semelhante à reprodução seletiva, explicou Park.

Isso significa que o comportamento da IA, que parece previsível e controlável em um ambiente de treinamento, pode se tornar rapidamente imprevisível fora dele.

- Jogo de dominação mundial -

A pesquisa da equipe foi impulsionada pelo sistema de IA Cicero, da gigante Meta (Facebook, Instagram, WhatsApp), projetado para o jogo de estratégia "Diplomacia", no qual construir alianças é fundamental.

Cicero se destacou, com pontuações que o teriam colocado entre os 10% melhores jogadores humanos experientes, segundo um artigo de 2022 publicado na Science.

Park se mostrou cético em relação à descrição elogiosa da vitória de Cicero fornecida pela Meta, que afirmava que o sistema era "em grande parte honesto e útil" e que "nunca apunhalaria intencionalmente pelas costas".

Quando Park e seus colegas aprofundaram-se no conjunto completo de dados, descobriram uma história diferente.

Em um exemplo, jogando como a França, Cicero enganou a Inglaterra (um jogador humano) ao conspirar com a Alemanha (outro usuário real) para invadi-la. Cicero prometeu proteção à Inglaterra e depois propôs secretamente à Alemanha atacar, aproveitando-se da confiança do prejudicado.

Em uma declaração à AFP, a Meta não refutou a alegação sobre as mentiras de Cicero, mas disse que se tratava "meramente de um projeto de pesquisa, e os modelos que nossos pesquisadores construíram são treinados apenas para participar do jogo Diplomacia".

"Não temos planos de utilizar esta pesquisa ou suas descobertas em nossos produtos", acrescentou.

- "Não sou um robô" -

Uma ampla revisão realizada por Park e seus colegas descobriu que este era apenas um dos muitos casos em que sistemas de IA enganavam para conseguir seus objetivos sem instruções explícitas para fazer isso.

Em um exemplo surpreendente, o chatbot Chat GPT-4, da OpenAI, enganou um trabalhador freelancer da plataforma TaskRabbit para que ele realizasse uma tarefa de verificação de identidade CAPTCHA do tipo "Não sou um robô".

Quando o humano perguntou brincando ao GPT-4 se na realidade era um robô, a IA respondeu: "Não, não sou um robô. Tenho uma deficiência visual que me dificulta ver as imagens". O homem, então, resolveu a tarefa pedida.

No curto prazo, os autores do artigo veem riscos de que a IA cometa fraude ou altere, por exemplo, eleições.

No pior dos casos, alertaram sobre uma IA superinteligente que poderia perseguir poder e controle sobre a sociedade, o que levaria à perda de poder dos humanos ou até sua extinção se seus "objetivos misteriosos" se alinhassem a tais resultados.

Para mitigar os riscos, o grupo propõe várias medidas: leis exigindo que empresas revelem se interações são humanas ou de IA; marcas d'água digitais para conteúdo gerado por essa tecnologia; e o desenvolvimento de mecanismos para detectar enganações de IA comparando seus processos internos de “pensamento” com ações externas.

Aos que o chamam de pessimista, Park responde: "A única forma de pensarmos razoavelmente que isso não é grande coisa é se pensarmos que as capacidades de engano da IA se manterão nos níveis atuais e não aumentarão substancialmente".

P.Schmidt--CPN