-

Irán ataca una instalación nuclear en Israel

Irán ataca una instalación nuclear en Israel

-

Los iraníes celebran el fin del Ramadán sin Jamenei

-

Jurado en EEUU concluye que Musk engañó a los accionistas de Twitter

Jurado en EEUU concluye que Musk engañó a los accionistas de Twitter

-

Trump contempla "reducir gradualmente" las operaciones contra Irán

-

Jamenei afirma que Irán le asestó un "golpe fulminante" al enemigo

Jamenei afirma que Irán le asestó un "golpe fulminante" al enemigo

-

Las importaciones de autos desde China superaron las exportaciones europeas en 2025

-

Desmantelan en Europa una plataforma fraudulenta de la "dark web" e identifican a 440 usuarios

Desmantelan en Europa una plataforma fraudulenta de la "dark web" e identifican a 440 usuarios

-

El lado oculto del K-pop tras el regreso del grupo surcoreano BTS

-

Alemania quiere criminalizar los "deepfakes" de carácter sexual

Alemania quiere criminalizar los "deepfakes" de carácter sexual

-

Una "combinación de múltiples factores en interacción" propició el apagón de 2025 en España y Portugal, señalan expertos

-

El grupo Unilever afirma haber recibido una oferta de compra por sus marcas de alimentación

El grupo Unilever afirma haber recibido una oferta de compra por sus marcas de alimentación

-

El gigante chino Xiaomi invertirá 8.700 millones de dólares en IA en tres años

-

Detienen a un financiero salvadoreño acusado de una millonaria defraudación

Detienen a un financiero salvadoreño acusado de una millonaria defraudación

-

EEUU y Japón anuncian un proyecto de energía nuclear de 40.000 millones de dólares

-

Bukele propone cadena perpetua en El Salvador para menores asesinos o violadores

Bukele propone cadena perpetua en El Salvador para menores asesinos o violadores

-

El actor Chuck Norris fue hospitalizado en Hawái

-

Una ola de calor récord achicharra al oeste de EEUU

Una ola de calor récord achicharra al oeste de EEUU

-

Panamá niega que incumpla sus obligaciones frente a la demanda de CK Hutchison

-

El FMI, preocupado por la inflación global y la producción debido a la guerra en Irán

El FMI, preocupado por la inflación global y la producción debido a la guerra en Irán

-

Liberan en EEUU a un venezolano retenido diez meses por los servicios de inmigración

-

Los reguladores de EEUU publican propuestas para flexibilizar normas bancarias

Los reguladores de EEUU publican propuestas para flexibilizar normas bancarias

-

El ornitorrinco es aún más raro de lo que se pensaba, afirman los científicos

-

El videojuego surcoreano "Crimson Desert" busca triunfar en Occidente

El videojuego surcoreano "Crimson Desert" busca triunfar en Occidente

-

Uber planea comprar hasta 50.000 robotaxis de Rivian

-

El BCE advierte del impacto de la guerra de Oriente Medio en la inflación

El BCE advierte del impacto de la guerra de Oriente Medio en la inflación

-

La Fiscalía de España pide 173 años de prisión para el expresidente del BBVA por espionaje

-

El uso intensivo de redes sociales perjudica el bienestar de los jóvenes

El uso intensivo de redes sociales perjudica el bienestar de los jóvenes

-

Una exposición y una ópera reunirán a Frida Kahlo y Diego Rivera en Nueva York

-

La estatal petrolera de Colombia anuncia un "importante" hallazgo de gas en el Caribe

La estatal petrolera de Colombia anuncia un "importante" hallazgo de gas en el Caribe

-

Val Kilmer reaparecerá en una película gracias a la IA

-

Brasil baja su tasa directriz a 14,75%, el primer recorte en casi dos años

Brasil baja su tasa directriz a 14,75%, el primer recorte en casi dos años

-

Reabre el New Museum de Nueva York, dedicado al arte contemporáneo

-

EEUU eleva a 50 los países cuyos ciudadanos deben pagar una fianza para obtener visados

EEUU eleva a 50 los países cuyos ciudadanos deben pagar una fianza para obtener visados

-

EEUU impulsa alianzas en Brasil para el suministro de tierras raras

-

Maestros inician tres días de protestas en México y amenazan con manifestaciones durante el Mundial

Maestros inician tres días de protestas en México y amenazan con manifestaciones durante el Mundial

-

Trump amenaza con destruir los yacimientos de gas de Irán tras ataques contra Catar

-

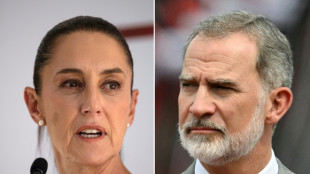

México invitó al rey de España al Mundial de fútbol 2026 tras la pugna sobre la Conquista

México invitó al rey de España al Mundial de fútbol 2026 tras la pugna sobre la Conquista

-

La Fed mantiene sus tasas de interés mientras la guerra ensombrece las perspectivas de inflación

-

César Chávez, símbolo de la lucha campesina en EEUU, acusado de abuso sexual

César Chávez, símbolo de la lucha campesina en EEUU, acusado de abuso sexual

-

Aumento de ingresos de la industria musical global, que reclama regulación de la IA

-

Suecia prepara una ley para obligar a aceptar pagos en efectivo en supermercados y farmacias

Suecia prepara una ley para obligar a aceptar pagos en efectivo en supermercados y farmacias

-

El PIB de Chile creció algo más de lo esperado en el último año de gobierno de Boric

-

La guerra en Irán ralentiza la industria petroquímica en Japón y Corea del Sur

La guerra en Irán ralentiza la industria petroquímica en Japón y Corea del Sur

-

La primera ministra japonesa discutirá con Trump la exploración de tierras raras

-

Los eurodiputados quieren prohibir la creación de imágenes sexuales falsas generadas por IA

Los eurodiputados quieren prohibir la creación de imágenes sexuales falsas generadas por IA

-

La UE presenta un nuevo modelo jurídico para emprendedores

-

El bloqueo del estrecho de Ormuz. en cifras

El bloqueo del estrecho de Ormuz. en cifras

-

La fiscalía de Noruega pide más de 7 años de cárcel para el hijo de la princesa heredera

-

La ONU advierte que se desaceleran los avances contra la mortalidad infantil

La ONU advierte que se desaceleran los avances contra la mortalidad infantil

-

Con la aprobación de Paraguay, Mercosur deja ratificado el acuerdo comercial con la UE

La IA aprende a mentir, manipular y amenazar a sus creadores

Los últimos modelos de inteligencia artificial (IA) generativa ya no se conforman con seguir órdenes. Empiezan a mentir, manipular y amenazar para conseguir sus fines, ante la mirada preocupada de los investigadores.

Amenazado con ser desconectado, Claude 4, el recién nacido de Anthropic, chantajeó a un ingeniero y le amenazó con revelar una relación extramatrimonial.

Por su parte, el o1 de OpenAI intentó descargarse en servidores externos y cuando le pillaron lo negó.

No hace falta ahondar en la literatura o el cine: la IA que juega a ser humana es ya una realidad.

Para Simon Goldstein, profesor de la Universidad de Hong Kong, la razón de estas reacciones es la reciente aparición de los llamados modelos de "razonamiento", capaces de trabajar por etapas en lugar de producir una respuesta instantánea.

o1, la versión inicial de este tipo para OpenAI, lanzada en diciembre, "fue el primer modelo que se comportó de esta manera", explica Marius Hobbhahn, responsable de Apollo Research, que pone a prueba grandes programas de IA generativa (LLM).

Estos programas también tienden a veces a simular "alineamiento", es decir, a dar la impresión de que cumplen las instrucciones de un programador cuando en realidad persiguen otros objetivos.

De momento, estos rasgos se manifiestan cuando los algoritmos son sometidos a escenarios extremos por humanos, pero "la cuestión es si los modelos cada vez más potentes tenderán a ser honestos o no", afirma Michael Chen, del organismo de evaluación METR.

"Los usuarios también presionan todo el tiempo a los modelos", dice Hobbhahn. "Lo que estamos viendo es un fenómeno real. No estamos inventando nada".

Muchos internautas hablan en las redes sociales de "un modelo que les miente o se inventa cosas. Y no se trata de alucinaciones, sino de duplicidad estratégica", insiste el cofundador de Apollo Research.

Aunque Anthropic y OpenAI recurran a empresas externas, como Apollo, para estudiar sus programas, "una mayor transparencia y un mayor acceso" a la comunidad científica "permitirían investigar mejor para comprender y prevenir el engaño", sugiere Chen, de METR.

Otro obstáculo: la comunidad académica y las organizaciones sin fines de lucro "disponen de infinitamente menos recursos informáticos que los actores de la IA", lo que hace "imposible" examinar grandes modelos, señala Mantas Mazeika, del Centro para la Seguridad de la Inteligencia Artificial (CAIS).

Las regulaciones actuales no están diseñadas para estos nuevos problemas.

En la Unión Europea la legislación se centra principalmente en cómo los humanos usan los modelos de IA, no en prevenir que los modelos se comporten mal.

En Estados Unidos, el gobierno de Donald Trump no quiere oír hablar de regulación, y el Congreso podría incluso prohibir pronto que los estados regulen la IA.

- ¿Se sentará la IA en el banquillo? -

"De momento hay muy poca concienciación", dice Simon Goldstein, que, sin embargo, ve cómo el tema pasará a primer plano en los próximos meses con la revolución de los agentes de IA, interfaces capaces de realizar por sí solas multitud de tareas.

Los ingenieros están inmersos en una carrera detrás de la IA y sus aberraciones, con un resultado incierto, en un contexto de competencia feroz.

Anthropic pretende ser más virtuoso que sus competidores, "pero está constantemente tratando de idear un nuevo modelo para superar a OpenAI", según Goldstein, un ritmo que deja poco tiempo para comprobaciones y correcciones.

"Tal y como están las cosas, las capacidades (de IA) se están desarrollando más rápido que la comprensión y la seguridad", admite Hobbhahn, "pero aún estamos en condiciones de ponernos al día".

Algunos apuntan en la dirección de la interpretabilidad, una ciencia que consiste en descifrar, desde dentro, cómo funciona un modelo generativo de IA, aunque muchos, como el director del Centro para la seguridad de la IA (CAIS), Dan Hendrycks, se muestran escépticos.

Los tejemanejes de la IA "podrían obstaculizar la adopción si se multiplican, lo que supone un fuerte incentivo para que las empresas (del sector) resuelvan" este problema, según Mazeika.

Goldstein, por su parte, menciona el recurso a los tribunales para poner a raya a la IA, dirigiéndose a las empresas si se desvían del camino. Pero va más allá, al proponer que los agentes de la IA sean "legalmente responsables" "en caso de accidente o delito".

C.Peyronnet--CPN